Trách nhiệm ai trong đạo đức và quyền riêng tư đang trở thành tiêu chuẩn đạo đức mới của thế giới công nghệ. Theo Báo cáo Stanford AI Index 2024, hơn 40 % doanh nghiệp toàn cầu từng gặp rủi ro vi phạm quyền riêng tư hoặc thiên lệch dữ liệu khi triển khai AI (Stanford AI Index 2024). OECD (2024) cũng ghi nhận 70 quốc gia đã hoặc đang xây dựng khung pháp lý về AI có trách nhiệm, tập trung vào đạo đức và quyền riêng tư (OECD AI Policy Observatory).

Tại Việt Nam, Nghị định 13/2023/NĐ-CP về bảo vệ dữ liệu cá nhân được coi là bước đầu quan trọng trong hành trình xây dựng môi trường AI an toàn. Tuy nhiên, để đưa các nguyên tắc đạo đức vào hoạt động hằng ngày của doanh nghiệp vẫn cần thêm thời gian và ý thức từ cộng đồng chuyên môn. Bảy bài học dưới đây sẽ giúp doanh nghiệp hiểu rõ cách chuyển từ AI “thông minh” sang AI “có trách nhiệm”.

1. Minh bạch – Nền tảng của Trách nhiệm AI Trong Đạo Đức Và Quyền Riêng Tư

Minh bạch là điều kiện tiên quyết để người dùng tin tưởng vào AI. Khi một mô hình có thể giải thích được cách nó ra quyết định, doanh nghiệp cũng kiểm soát được rủi ro và người dùng cảm thấy an toàn hơn.

- Giải thích thuật toán rõ ràng: Theo IBM Research (2024), 57 % tổ chức thừa nhận họ không thể mô tả logic ra quyết định của mô hình AI mình đang vận hành (IBM AI Governance Survey 2024). Việc áp dụng Explainable AI (XAI) giúp người quản lý và khách hàng nhìn thấy các yếu tố ảnh hưởng đến kết quả. Khi AI “sáng tỏ”, niềm tin cũng được củng cố.

- Minh bạch trong xử lý dữ liệu: Doanh nghiệp cần công khai cách thu thập, mục đích sử dụng và thời gian lưu trữ dữ liệu. Người dùng nên được quyền rút lại sự đồng ý hoặc yêu cầu xóa dữ liệu. Điều này thể hiện sự tôn trọng và phòng ngừa khủng hoảng niềm tin.

- Văn hóa minh bạch nội bộ: Không chỉ đội kỹ thuật mới phải hiểu về AI; mọi phòng ban đều cần nắm được nguyên tắc vận hành và giới hạn của hệ thống. Một văn hóa minh bạch giúp phát hiện vấn đề đạo đức từ sớm và tăng trách nhiệm tập thể.

Minh bạch là thước đo đầu tiên của AI có trách nhiệm. Khi mỗi quyết định của AI được giải thích, doanh nghiệp đã tạo ra hàng rào bảo vệ niềm tin vững chắc.

Xem thêm: 3 Thách Thức Lớn Trong Trách Nhiệm AI: Đạo Đức, Quyền Riêng Tư Và Năng Lượng

2. Công bằng dữ liệu – Đạo đức bắt đầu từ đầu vào

Nếu đầu vào thiên lệch, đầu ra của AI sẽ thiên lệch. Công bằng dữ liệu là một trong những bài học đạo đức cốt lõi nhất mà mọi tổ chức phải học.

- Nhận diện và xử lý thiên lệch: Theo Harvard Business Review (2024), 65 % doanh nghiệp chưa có cơ chế kiểm toán bias dữ liệu (HBR 2024). Một tập dữ liệu lịch sử có định kiến giới tính hoặc vùng miền có thể làm AI đánh giá sai về ứng viên hoặc khách hàng. Nhận diện sớm bias giúp ngăn ngừa thiệt hại và bảo vệ hình ảnh doanh nghiệp.

- Thiết lập chu kỳ Data Audit: Kiểm toán dữ liệu định kỳ là cách duy trì sự đại diện và cập nhật thực tế. Chu kỳ này nên được thiết kế thành quy trình chuẩn trong mỗi giai đoạn phát triển AI. Một môi trường dữ liệu sạch và công bằng giúp AI phản ánh xã hội đa chiều thay vì rập khuôn.

- Đa dạng đội ngũ phát triển: Một nhóm kỹ sư đa giới tính và đa văn hóa có khả năng phát hiện thiên lệch nhanh hơn. Khi các góc nhìn khác nhau cùng tham gia xây dựng mô hình, sản phẩm AI sẽ phản ánh giá trị chung của xã hội thay vì ý chí riêng của một nhóm.

Công bằng dữ liệu không chỉ là vấn đề kỹ thuật mà là hành vi đạo đức. Một AI được nuôi dưỡng từ dữ liệu sạch sẽ mang lại quyết định đáng tin cậy hơn cho cả doanh nghiệp và xã hội.

3. Bảo vệ quyền riêng tư – Khi tôn trọng trở thành chuẩn mực

Bảo vệ quyền riêng tư là biểu hiện cao nhất của trách nhiệm AI. Dữ liệu cá nhân là tài sản vô hình nhưng vô giá, và việc sử dụng chúng phải được đặt trên nền tảng tôn trọng.

- Thiết kế Privacy by Design: Theo Apple Privacy Overview (2024), khi bảo mật được tích hợp ngay từ giai đoạn thiết kế, rủi ro rò rỉ dữ liệu giảm trên 60 % (Apple Privacy Report 2024). Doanh nghiệp cần áp dụng các biện pháp như mã hóa, ẩn danh và phân quyền truy cập ngay từ đầu chu trình phát triển.

- Tuân thủ và nội địa hóa chính sách: Singapore đi đầu với PDPA và AI Verify; Việt Nam đang thực thi Nghị định 13/2023/NĐ-CP. Tuy vậy, doanh nghiệp cần biến quy định thành hành động cụ thể – xây cấu trúc quản lý dữ liệu phù hợp với quy mô và ngành nghề.

- Trao quyền cho người dùng: Người dùng nên được quyền xem, chỉnh sửa và xóa dữ liệu của mình. Việc tạo ra bảng điều khiển (quản lý quyền riêng tư) giúp họ tự chọn mức độ chia sẻ, đồng thời tăng niềm tin với doanh nghiệp.

Quyền riêng tư là nền tảng của tôn trọng. Khi doanh nghiệp xem dữ liệu người dùng là niềm tin, không phải nguồn thu, AI mới thực sự được xây dựng trên giá trị đạo đức.

4. Con người – Trung tâm của mọi hệ thống AI

Trí tuệ nhân tạo có thể học hàng tỷ mẫu dữ liệu, nhưng chỉ con người mới có khả năng phán xét đạo đức. Do đó, một AI có trách nhiệm phải đặt con người làm trung tâm mọi quyết định.

- Áp dụng Human-in-the-loop (HITL): Theo Deloitte Insights (2024), mô hình HITL giúp giảm 32 % sai lệch quyết định so với AI tự động (Deloitte Responsible AI Study 2024). Con người được đưa vào vòng lặp kiểm tra các tình huống rủi ro cao, như tài chính hoặc tuyển dụng, đảm bảo AI phục vụ thay vì thay thế.

- Đào tạo nhận thức đạo đức AI: Các chương trình huấn luyện nội bộ giúp kỹ sư và quản lý hiểu tác động xã hội của AI. Khi con người ý thức được trách nhiệm, AI được lập trình với sự cân nhắc và nhân tính.

- Rõ trách nhiệm pháp lý: Khi AI gây thiệt hại, ẩn sau thuật toán vẫn là con người. Việc xác định rõ cá nhân hoặc bộ phận chịu trách nhiệm bảo đảm tính minh bạch và công bằng trong pháp lý.

Không có AI vô tội; chỉ có con người vô tâm. Khi con người định hướng và chịu trách nhiệm, AI trở thành công cụ nâng tầm nhân loại chứ không đe dọa nó.

5. Chia sẻ dữ liệu có trách nhiệm – Giữa hợp tác và bảo mật

AI phát triển nhờ dữ liệu, nhưng chia sẻ dữ liệu thiếu kiểm soát lại là mối nguy lớn cho niềm tin xã hội. Một phần cốt lõi của trách nhiệm AI Trong Đạo Đức Và Quyền Riêng Tư là biết cách cân bằng giữa đổi mới và bảo mật trong quá trình hợp tác.

- Áp dụng mô hình Data Trusts: Mô hình này, được thí điểm ở Anh và Singapore, cho phép một bên thứ ba trung lập quản lý và cấp quyền truy cập dữ liệu giữa các tổ chức (PDPC Singapore 2024). Thay vì trao toàn bộ dữ liệu cho đối tác, doanh nghiệp chia sẻ thông qua cơ chế kiểm soát. Cách này vừa đảm bảo minh bạch, vừa giảm thiểu rủi ro lạm dụng dữ liệu.

- Kết hợp blockchain để đảm bảo truy xuất nguồn dữ liệu: Blockchain lưu lại lịch sử mọi thao tác với dữ liệu, tạo thành “chuỗi niềm tin” bất biến. Một công ty tài chính tại Việt Nam đã thử nghiệm dùng blockchain cho hồ sơ tín dụng, giúp khách hàng yên tâm vì mọi thay đổi đều có thể kiểm chứng.

- Minh bạch mục đích chia sẻ: Người dùng có quyền biết dữ liệu của họ được chia sẻ với ai và vì mục đích gì. Việc minh bạch hóa này không chỉ là nghĩa vụ pháp lý mà còn là yếu tố đạo đức quan trọng để giữ niềm tin.

Chia sẻ dữ liệu có trách nhiệm giúp AI lớn mạnh mà không đánh đổi sự riêng tư. Khi hợp tác và bảo mật cùng tồn tại, công nghệ trở nên bền vững và đáng tin hơn

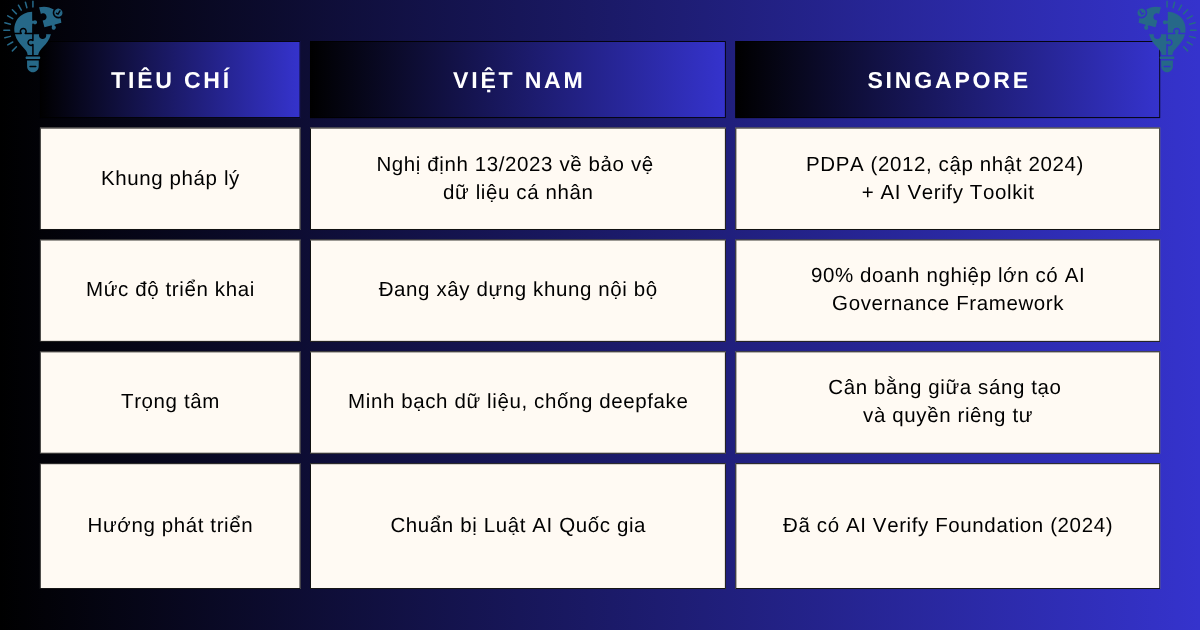

6. Việt Nam và Singapore – Hai hướng tiếp cận Trách nhiệm AI

Khung pháp lý là nền tảng để đảm bảo AI được phát triển đúng hướng. Việt Nam và Singapore đều là những quốc gia châu Á tích cực trong việc thúc đẩy AI có trách nhiệm, nhưng cách tiếp cận của họ mang những khác biệt thú vị.

Ở Singapore, chương trình AI Verify Toolkit được chính phủ phát triển như công cụ chuẩn đánh giá minh bạch và công bằng của AI. Trong khi đó, Việt Nam đang từng bước hoàn thiện hành lang pháp lý, kết hợp yếu tố quốc tế với đặc thù nội địa để hình thành khung “AI có đạo đức”. Sự khác biệt nằm ở tốc độ và hướng tiếp cận, nhưng cả hai cùng hướng tới mục tiêu tạo ra hệ sinh thái AI an toàn cho con người.

Mỗi quốc gia có lộ trình riêng, nhưng điểm đến chung vẫn là AI nhân văn. Việt Nam hoàn toàn có thể học hỏi cách Singapore kết hợp luật pháp với đổi mới để xây dựng “AI vì con người”.

Xem thêm: 7 Điểm Khác Biệt Văn Hóa Làm Việc IT Của Singapore Và Việt Nam

7. Giáo dục đạo đức AI – Nền tảng của công nghệ nhân bản

Không có đạo đức thì không thể có AI bền vững. Giáo dục được xem là gốc rễ giúp doanh nghiệp, chính phủ và người dân cùng hiểu về trách nhiệm AI Trong Đạo Đức Và Quyền Riêng Tư trong thời đại dữ liệu.

- Đưa đạo đức AI vào đào tạo chính quy: Nhiều trường như Stanford, NUS và Đại học Bách Khoa Hà Nội đã bổ sung môn “AI và Đạo đức” vào chương trình kỹ sư. Học sinh không chỉ học cách lập trình, mà còn được đào tạo về ảnh hưởng xã hội của công nghệ.

- Huấn luyện nội bộ cho doanh nghiệp: Theo Accenture (2024), 78 % tổ chức xác nhận chương trình đào tạo “Ethical AI” giúp giảm đáng kể rủi ro pháp lý và tăng uy tín thương hiệu (Accenture Responsible AI Report 2024). Việc xây dựng chương trình đào tạo nội bộ giúp nhân viên hiểu rằng mỗi quyết định kỹ thuật đều mang trách nhiệm xã hội.

- Thúc đẩy hợp tác liên ngành: Khi kỹ sư, nhà quản trị, chuyên gia luật và xã hội học cùng tham gia vào quá trình phát triển AI, quyết định được đưa ra sẽ cân bằng hơn giữa lợi ích kinh tế và giá trị con người. Đây là hướng đi mà nhiều tập đoàn toàn cầu đang áp dụng để bảo đảm AI vừa mạnh, vừa có đạo đức.

Giáo dục đạo đức AI là nền móng cho tương lai công nghệ nhân bản. Khi con người hiểu đạo đức, họ sẽ dạy cho máy cách hành xử đúng — và đó mới là thành tựu thật sự của trí tuệ nhân tạo.

Đọc thêm: 4 Cách Xây Dựng Trách Nhiệm AI Trong Minh Bạch Và Niềm Tin

Trách nhiệm AI không chỉ là khẩu hiệu, mà là thước đo văn minh của thời đại số. Khi doanh nghiệp đặt minh bạch làm nền tảng, công bằng làm nguyên tắc và quyền riêng tư làm giới hạn, AI sẽ trở thành công cụ phục vụ nhân loại thay vì kiểm soát nó.

Việt Nam đang có cơ hội vàng để định hình cách thế giới nhìn nhận về công nghệ nhân bản. Khi nhà quản lý, kỹ sư và người dùng cùng hiểu rõ giá trị của đạo đức và minh bạch, chúng ta có thể tạo ra một thế hệ AI biết “học để phục vụ” chứ không “học để thay thế”.

Tại HR1Tech, chúng tôi tin rằng tương lai bền vững của AI không đến từ việc lập trình chính xác hơn, mà từ những con người biết hành động có trách nhiệm hơn.